为什么必须评估

OpenAI 的 Evals 指南强调:没有评估就没有可靠性。尤其在更换模型或优化提示词时,必须用指标衡量,否则只是“主观感觉变好”。

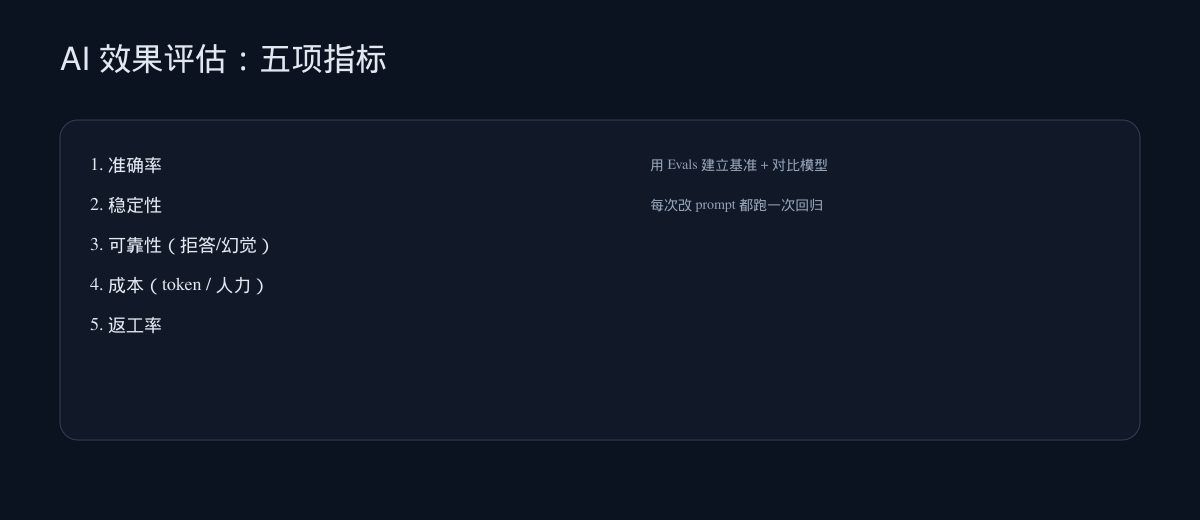

五个核心指标

- 准确率:输出是否正确

- 稳定性:相同输入是否一致

- 可靠性:拒答/幻觉率

- 成本:token 消耗 + 人工返工

- 返工率:需要人类修正的比例

评估流程(参考 Evals 思路)

- 描述任务目标(明确成功标准)

- 准备测试样本(真实场景输入)

- 运行评估(对比不同模型/提示词)

- 分析结果(找差距)

- 迭代优化(再次评估)

这与行为驱动开发(BDD)非常类似:先定义行为,再验证。

实操建议

- 每次升级模型都跑一次基准

- 提示词调整后必测回归

- 低频高价值任务优先做人工评审

小结

AI 评估不是“学术工作”,而是工程必需品。只要你坚持五项指标,AI 工具就能从“好像不错”变成“可预测、可迭代”。

推荐工具

Affiliate Ready这里可替换为你的联盟链接(目前为官方链接)。

相关推荐

AI 提示词工程实战:第一篇 · 什么是结构化提示词AI 提示词工程实战:第二篇 · 邮件自动化模板AI 提示词工程实战:第三篇 · 报告生成模板AI 提示词工程实战:第四篇 · 沟通协作模板AI 提示词工程实战:第五篇 · 内容创作模板AI 提示词工程实战:第六篇 · 数据分析模板AI 提示词工程实战:第七篇 · 100个职场必备模板下载AI 提示词工程实战:第八篇 · 高级技巧与最佳实践AI 提示词工程实战:第九篇 · 常见误区与避坑指南AI 提示词工程实战:第十篇 · 总结与资源汇总智能工作坊 · AI 提示词实战课FreqTrade 从 0 到 1:第一集 · 认识系统架构FreqTrade 从 0 到 1:第二集 · 回测框架与指标体系AI 工具最小闭环:从需求到上线AI 编程工具实战:代码审查清单模板AI 编程工具实战:上下文管理是生产力关键AI 编程工具实战:48 小时快速原型方法AI 编程工具实战:提示词运营(Prompt Ops)入门AI 编程工具实战:质量门禁四步法AI 编程工具实战:本地开发流从 0 到 1OpenClaw 使用指南:多任务协作工作流OpenClaw 使用指南:自动化任务配方OpenClaw 使用指南:部署与验收检查清单OpenClaw 使用指南:文档阅读路线图OpenClaw 使用指南:从 0 到可用的自动化流程量化策略入门:回测的 3 个关键误区量化策略入门:仓位管理的最小公式量化策略入门:先做风控,再谈收益量化策略入门:信号验证的三重过滤量化策略入门:三类策略的优缺点